Retrieval-Augmented Generation (RAG) und Fine-Tuning sind die zwei zentralen Architekturansätze, um Large Language Models mit Unternehmenswissen auszustatten. Die Wahl zwischen beiden hat weitreichende Konsequenzen für Kosten, Datenaktualität, Genauigkeit und Betriebsaufwand. Dieser Artikel liefert die Entscheidungsgrundlage.

Das Kernproblem: LLMs kennen Ihre Daten nicht

Large Language Models verfügen über beeindruckendes Allgemeinwissen, das während des Trainings erworben wurde. Doch sie kennen weder Ihre internen Richtlinien noch Ihre Produktdokumentation, Ihre Vertragsdaten oder Ihre spezifischen Geschäftsprozesse. Zwei Ansätze lösen dieses Problem grundlegend unterschiedlich.[1]

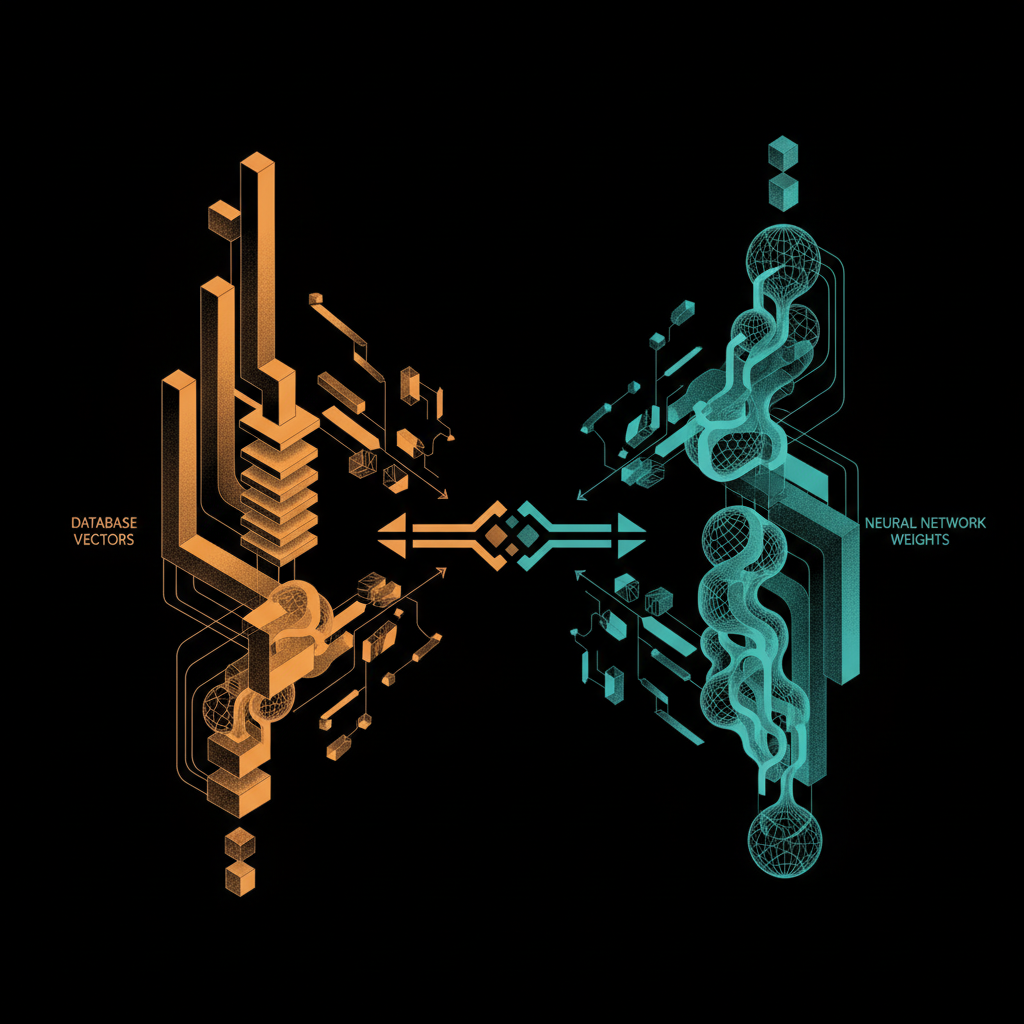

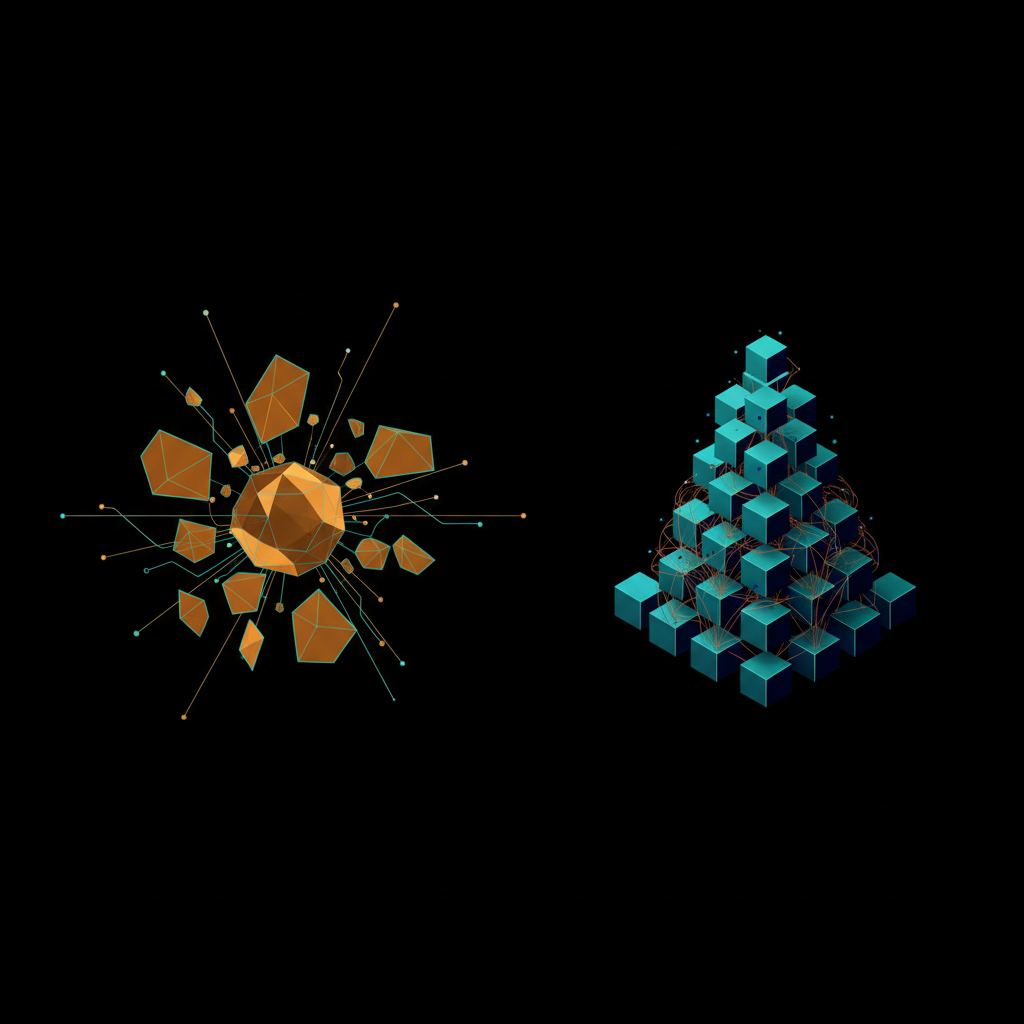

Retrieval-Augmented Generation (RAG) reichert die Anfrage zur Laufzeit mit relevantem Kontext an: Dokumente werden in einer Vektordatenbank indexiert, bei jeder Anfrage werden die relevantesten Passagen abgerufen und dem LLM als Kontext mitgegeben. Das Modell selbst wird nicht verändert.[2]

Fine-Tuning passt die Gewichte des Modells durch weiteres Training auf domänenspezifischen Daten an. Das Modell „lernt" Ihre Terminologie, Ihren Stil und Ihr Fachwissen und kann dieses Wissen anschliessend ohne zusätzlichen Kontext abrufen.[3]

Beide Ansätze haben klare Stärken und Schwächen. Die Entscheidung hängt von Ihrem konkreten Use Case, Ihrem Datenvolumen und Ihren operativen Anforderungen ab.

RAG: Architektur und Funktionsweise

Ein RAG-System besteht aus drei Kernkomponenten:

Ingestion Pipeline: Dokumente werden geladen, in Chunks aufgeteilt, durch ein Embedding-Modell in Vektoren umgewandelt und in einer Vektordatenbank (Pinecone, Weaviate, Qdrant, pgvector) gespeichert.

Retrieval: Bei einer Anfrage wird der Query-Vektor gegen die Datenbank abgeglichen. Die Top-k relevantesten Chunks werden extrahiert — typischerweise via Cosine Similarity oder Hybrid Search (Vektor + Keyword).[2]

Generation: Die abgerufenen Chunks werden als Kontext in den Prompt des LLM eingefügt. Das Modell generiert seine Antwort basierend auf diesem angereicherten Kontext.

Frameworks wie LlamaIndex und LangChain abstrahieren diese Pipeline und bieten produktionsreife Implementierungen mit Caching, Reranking und Evaluation-Tools.[4]

Fine-Tuning: Wann es die bessere Wahl ist

Fine-Tuning eignet sich besonders, wenn das Modell einen bestimmten Stil, eine spezifische Terminologie oder ein konsistentes Ausgabeformat lernen soll. Typische Anwendungsfälle:

Domänensprache: Medizinische, juristische oder technische Fachsprache, die das Basismodell nicht ausreichend beherrscht.

Ausgabeformat: Wenn jede Antwort einem strikten Schema folgen muss — etwa strukturierte JSON-Outputs für nachgelagerte Systeme.

Latenzoptimierung: Fine-Tuning eliminiert den Retrieval-Schritt. Bei Echtzeit-Anwendungen kann die eingesparte Latenz (100-500ms pro Anfrage) entscheidend sein.[3]

Die Kosten für Fine-Tuning sind seit 2024 drastisch gesunken: OpenAI bietet Fine-Tuning von GPT-4o ab 25 USD pro Million Trainingstoken an; Open-Source-Alternativen wie QLoRA ermöglichen effizientes Fine-Tuning auf einer einzelnen GPU.[5]

„RAG und Fine-Tuning sind keine Gegensätze — die leistungsstärksten Produktionssysteme kombinieren beide Ansätze. Fine-Tuning für Stil und Format, RAG für aktuelle Fakten."

— Jerry Liu, CEO LlamaIndex (2025)

Entscheidungsmatrix: RAG vs. Fine-Tuning

RAG — Ihre Wahl wenn:

- Daten sich häufig ändern (Wochen/Tage)

- Quellennachweis und Transparenz kritisch sind

- Budget für Vektordatenbank-Infrastruktur vorhanden

- Schneller Start gewünscht (Tage statt Wochen)

- Halluzinationsreduktion oberste Priorität hat

- Kosten: 0,01-0,05 USD pro Anfrage (Embedding + LLM)

Fine-Tuning — Ihre Wahl wenn:

- Domänensprache/Stil dauerhaft konsistent sein muss

- Daten sich selten ändern (Monate/Jahre)

- Latenz unter 200ms erforderlich ist

- Kein Retrieval-Overhead gewünscht

- Spezifisches Ausgabeformat nötig ist

- Kosten: 50-500 USD einmalig + Standard-Inferenz

Handlungsempfehlungen für CIOs

Mit RAG starten: Für 80 Prozent der Enterprise-Use-Cases ist RAG der richtige Einstieg — schneller implementiert, einfacher zu aktualisieren und transparenter in der Quellenangabe.

Hybridansatz evaluieren: Die stärksten Produktionssysteme nutzen ein fine-getuntes Basismodell (für Stil und Format) kombiniert mit RAG (für aktuelle Fakten und Quellennachweis).

Vektordatenbank-Strategie festlegen: Evaluieren Sie Managed Services (Pinecone, Weaviate Cloud) gegen Self-Hosted (pgvector, Qdrant) anhand Ihrer Datensouveränitäts-Anforderungen.

Evaluation automatisieren: Implementieren Sie automatisierte Quality-Gates mit Metriken wie Faithfulness, Answer Relevancy und Hallucination Rate — Tools wie RAGAS oder DeepEval unterstützen dabei.

Kostenmodell durchrechnen: RAG verursacht laufende Kosten pro Anfrage (Embedding + Retrieval + Generation); Fine-Tuning ist initial teurer, aber pro Inferenz günstiger. Modellieren Sie beide Szenarien für Ihr erwartetes Anfragevolumen.

Quellen und Referenzen

- Patrick Lewis et al.: „Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks", NeurIPS 2020. arXiv:2005.11401.

- Pinecone: „What is Retrieval-Augmented Generation (RAG)?", Pinecone Learning Center, 2025. https://www.pinecone.io/learn/retrieval-augmented-generation

- OpenAI: „Fine-tuning Guide", OpenAI Platform Documentation, 2025. https://platform.openai.com/docs/guides/fine-tuning

- Jerry Liu et al.: „LlamaIndex: A Data Framework for LLM Applications", LlamaIndex Documentation, 2025. https://docs.llamaindex.ai

- Tim Dettmers et al.: „QLoRA: Efficient Finetuning of Quantized Language Models", NeurIPS 2023. arXiv:2305.14314.

- Anthropic: „Retrieval-Augmented Generation Best Practices", Anthropic Documentation, 2025. https://docs.anthropic.com

- Shahul ES et al.: „RAGAS: Automated Evaluation of Retrieval Augmented Generation", arXiv:2309.15217, 2023.