Der EU AI Act (Verordnung (EU) 2024/1689)[1] ist seit dem 1. August 2024 in Kraft und entfaltet seine Wirkung in Stufen. Für IT-Leiter im Mittelstand bedeutet das: Jetzt handeln, nicht abwarten. Denn die ersten Verbote gelten bereits seit dem 2. Februar 2025, und die Anforderungen für Hochrisiko-KI greifen ab dem 2. August 2026.[2] Wer seine KI-Anwendungen nicht kennt, kann sie nicht klassifizieren — und wer nicht klassifiziert, riskiert Bußgelder von bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes.[1]

Die vier Risikoklassen

Der AI Act klassifiziert KI-Systeme in vier Stufen — und je höher das Risiko, desto strenger die Anforderungen:[1]

- Verboten: Social Scoring, manipulative Systeme, biometrische Echtzeit-Fernidentifikation im öffentlichen Raum (seit 2. Februar 2025)[2]

- Hochrisiko: KI in Personalauswahl, Kreditwürdigkeitsprüfung, kritischer Infrastruktur, Bildung — hier gelten die strengsten Auflagen (Anhang III der Verordnung)[1]

- Begrenztes Risiko: Chatbots, Deepfakes — Transparenzpflichten (Nutzer müssen wissen, dass sie mit KI interagieren)

- Minimales Risiko: Spamfilter, Empfehlungssysteme — keine besonderen Pflichten

Die Herausforderung: Viele Mittelständler wissen nicht, in welche Kategorie ihre KI-Anwendungen fallen. Eine systematische Bestandsaufnahme ist der erste Schritt.

Fristen, die Sie kennen müssen

Der AI Act tritt gestaffelt in Kraft:[2]

- 2. Februar 2025: Verbotene KI-Praktiken müssen eingestellt sein; Verpflichtungen zur KI-Kompetenz gelten (Kapitel I und II)[1]

- 2. August 2025: Regeln für General-Purpose AI (GPAI) wie ChatGPT, Gemini — betrifft Anbieter, aber auch Nutzer mit Integrationspflichten. Mitgliedstaaten müssen nationale Aufsichtsbehörden benennen.[2]

- 2. August 2026: Vollständige Anwendung für Hochrisiko-KI gemäß Anhang III — Konformitätsbewertung, technische Dokumentation, Registrierung in der EU-Datenbank, menschliche Aufsicht[1]

- 2. August 2027: Nachrüstpflicht für Hochrisiko-Systeme in regulierten Produkten (Anhang I) sowie für vor August 2025 auf dem Markt befindliche GPAI-Modelle[2]

Wer erst 2026 mit der Vorbereitung beginnt, wird die Fristen nicht halten. Die Dokumentationsanforderungen allein können Monate in Anspruch nehmen.

Die meisten Unternehmen unterschätzen den AI Act, weil sie glauben, nur Tech-Konzerne seien betroffen. In Wahrheit trifft er jedes Unternehmen, das KI in HR-Prozessen, Kundenbewertung oder Qualitätskontrolle einsetzt.

Der Compliance-Fahrplan

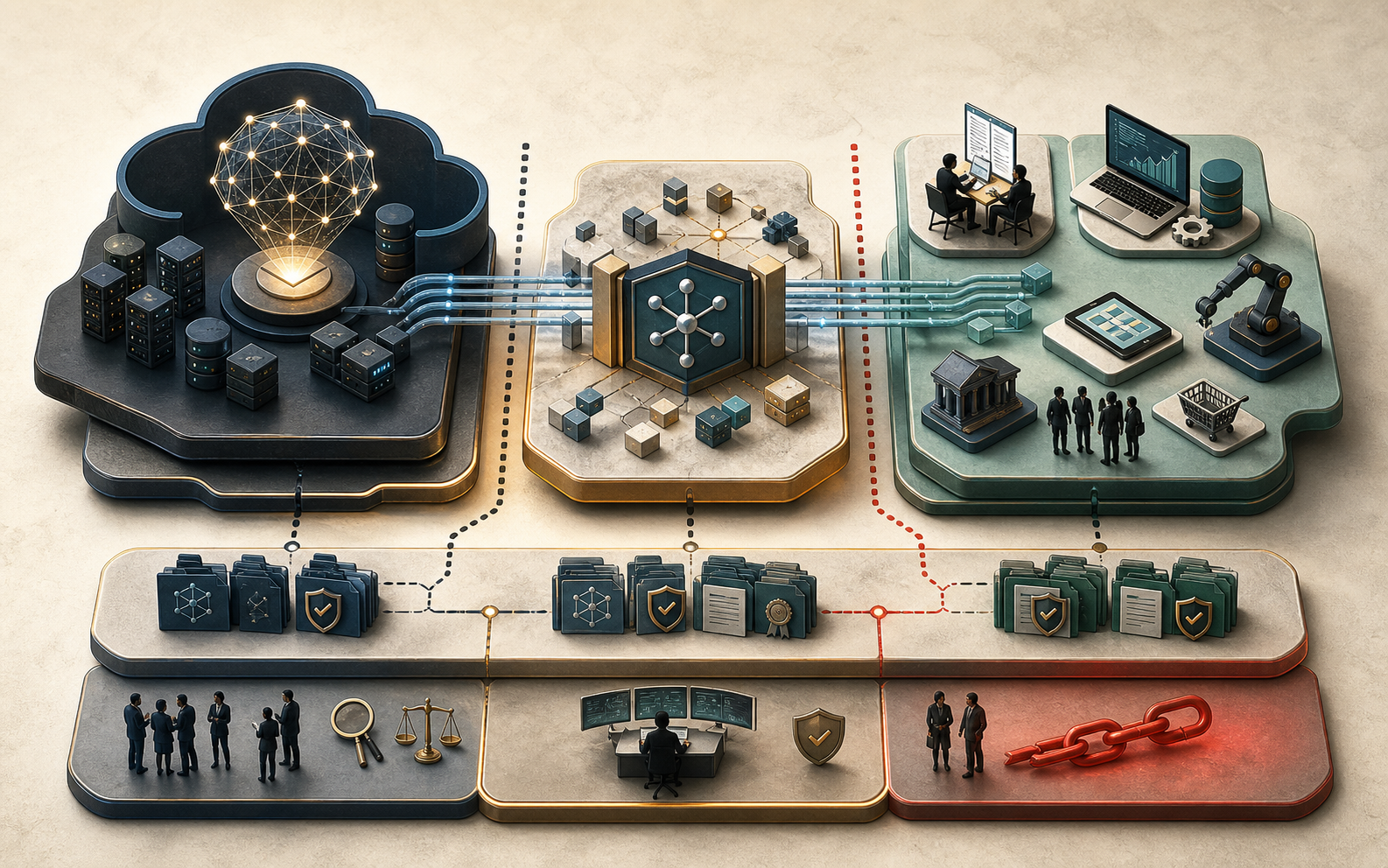

Eine pragmatische Umsetzung folgt vier Phasen:

- Inventarisierung (sofort): Erstellen Sie ein zentrales KI-Register aller eingesetzten Systeme — auch eingekaufte SaaS-Tools mit KI-Komponenten

- Klassifizierung (Monat 1–2): Ordnen Sie jedes System einer Risikoklasse zu. Nutzen Sie die Leitlinien der EU-Kommission zu Artikel 6 als Orientierung[3]

- Gap-Analyse (Monat 2–4): Für Hochrisiko-Systeme: Welche Dokumentation fehlt? Gibt es menschliche Aufsicht? Ist das Training der Daten nachvollziehbar?

- Umsetzung (Monat 4–12): Technische und organisatorische Maßnahmen implementieren — Logging, Bias-Tests, Dokumentation, Schulungen

GPAI und die Lieferkette

Besondere Aufmerksamkeit verdienen General-Purpose AI Modelle. Wenn Sie GPT-4, Claude oder Gemini über APIs in Ihre Prozesse integrieren, sind Sie als "Deployer" mitverantwortlich:[1]

- Transparenzpflicht: Kunden und Mitarbeiter müssen wissen, wenn sie mit KI-generierten Inhalten interagieren

- Risikofolgenabschätzung: Bei Integration in Hochrisiko-Kontexte müssen Sie eine eigene Bewertung durchführen

- Datenschutz-Schnittstelle: DSGVO und AI Act greifen ineinander — personenbezogene Trainingsdaten unterliegen beiden Regelwerken[4]

Die Bußgeldstufen sind nach Schwere gestaffelt: bis zu 35 Mio. € bzw. 7 % des Umsatzes für verbotene Praktiken, bis zu 15 Mio. € bzw. 3 % für Hochrisiko-Verstöße, und bis zu 7,5 Mio. € bzw. 1 % für falsche Angaben gegenüber Behörden.[1] Für KMU gelten jeweils die niedrigeren Beträge.[5]

Was das für Ihre IT-Strategie bedeutet

- Starten Sie diese Woche mit dem KI-Register — eine einfache Tabelle mit System, Anbieter, Einsatzzweck und Risikoeinschätzung genügt zunächst

- Benennen Sie einen AI-Act-Verantwortlichen, der die Koordination zwischen IT, Recht und Fachbereichen übernimmt

- Prüfen Sie Ihre HR- und Finanz-Tools auf KI-Komponenten — hier lauern die häufigsten Hochrisiko-Überraschungen

- Fordern Sie von SaaS-Anbietern AI-Act-Konformitätserklärungen ein — das wird Standard in Beschaffungsprozessen

- Planen Sie Budget für Compliance-Dokumentation und ggf. externe Konformitätsbewertung ein — unterschätzen Sie den Aufwand nicht

Quellen und Referenzen

- Europäisches Parlament und Rat: Verordnung (EU) 2024/1689 zur Festlegung harmonisierter Vorschriften für Künstliche Intelligenz (AI Act), Amtsblatt der Europäischen Union, 12. Juli 2024. https://eur-lex.europa.eu/eli/reg/2024/1689/oj

- EU AI Act Implementation Timeline, EU AI Act Service Desk der Europäischen Kommission, 2024. https://ai-act-service-desk.ec.europa.eu

- Europäische Kommission: Leitlinien zur Klassifizierung von Hochrisiko-KI-Systemen gemäß Artikel 6, geplant bis Februar 2026.

- Europäischer Datenschutzausschuss (EDPB): "Statement on AI and Data Protection", EDPB, 2024.

- Baker McKenzie: "EU Regulation on AI – Key Compliance Considerations", 2024. https://www.bakermckenzie.com/en/insight/publications/resources/product-risk-radar-articles/eu-regulation-on-ai

- Bitkom e.V.: "Praxisleitfaden zum EU AI Act für Unternehmen", Bitkom, 2024. https://www.bitkom.org

- Freshfields Bruckhaus Deringer: "EU AI Act Unpacked: Understanding Fines under the AI Act", 2024. https://technologyquotient.freshfields.com