Die Diskussion um die richtige Datenarchitektur hat sich 2026 auf zwei dominante Paradigmen verdichtet: Data Mesh und Data Lakehouse. Beide Ansätze versprechen, die Probleme klassischer Data Warehouses und Data Lakes zu lösen — aber auf fundamental unterschiedliche Weise.[1]

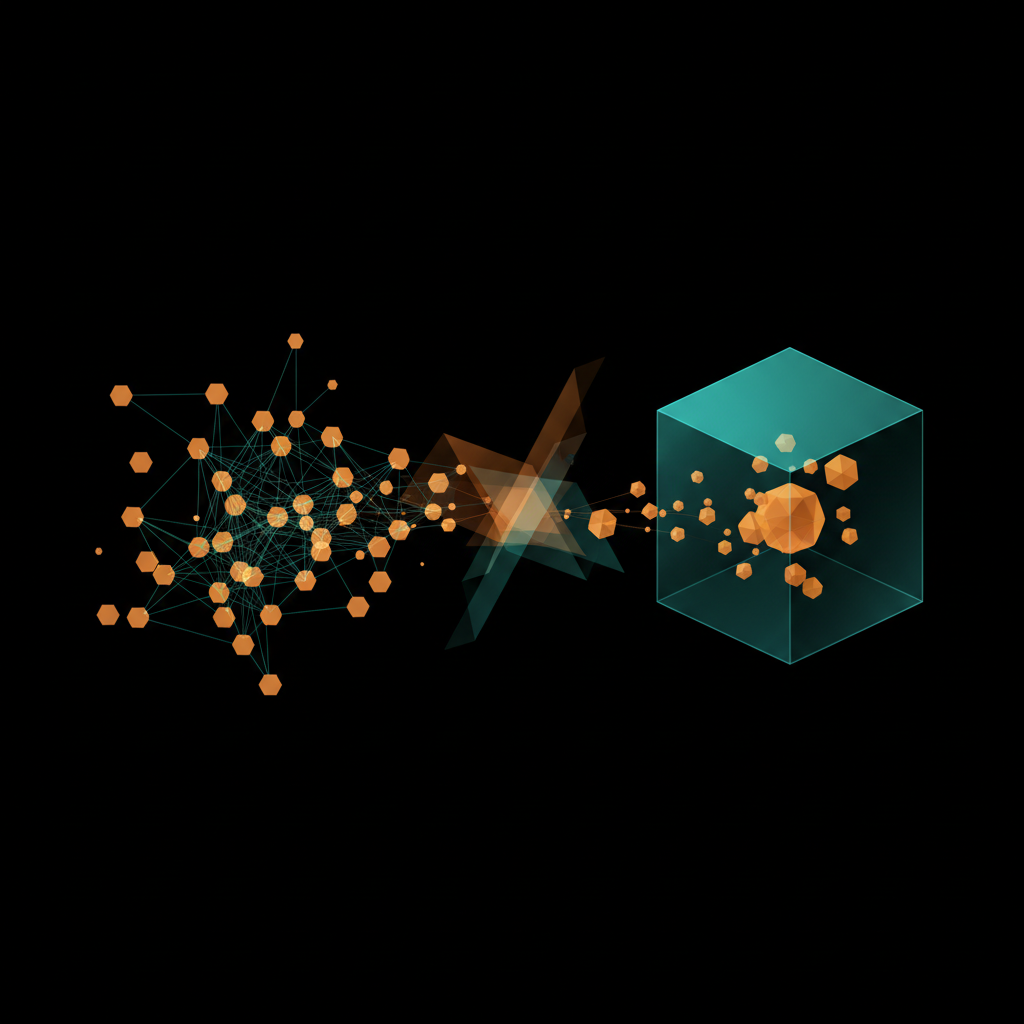

Data Mesh, erstmals 2019 von Zhamak Dehghani bei ThoughtWorks beschrieben, verfolgt einen dezentralen Ansatz: Daten werden als Produkt behandelt, die Verantwortung liegt bei den Fachdomänen, und eine Self-Service-Plattform ermöglicht autonomes Arbeiten.[2] Data Lakehouse, maßgeblich von Databricks popularisiert, kombiniert die Flexibilität eines Data Lakes mit der Struktur und Performance eines Data Warehouse auf einer einheitlichen Plattform.[3]

Für CIOs im Mittelstand stellt sich die Frage: Welcher Ansatz passt zu meiner Organisation, meiner Datenmenge und meinem Team? Die Antwort ist selten ein klares Entweder-oder.

Data Mesh: Das dezentrale Paradigma

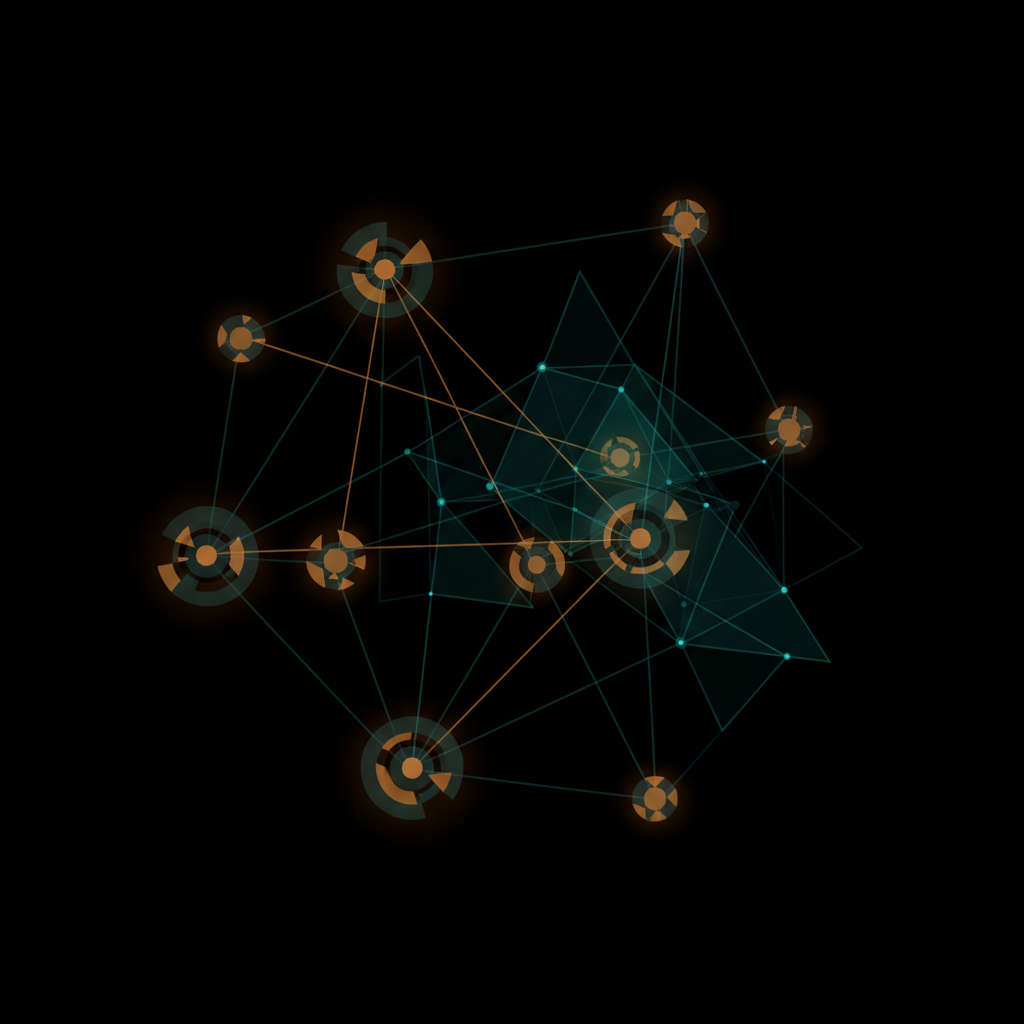

Zhamak Dehghanis Data-Mesh-Konzept basiert auf vier Grundprinzipien:[2]

1. Domain Ownership: Jede Geschäftsdomäne (Vertrieb, Produktion, Finanzen) ist für ihre Daten verantwortlich — von der Erzeugung bis zur Bereitstellung als Datenprodukt.

2. Data as a Product: Daten werden mit denselben Qualitätsstandards behandelt wie Software-Produkte: mit SLAs, Dokumentation, Discoverability und definierten Schnittstellen.

3. Self-Service Data Platform: Eine zentrale Plattform stellt Infrastruktur, Tools und Standards bereit, sodass Domänen-Teams eigenständig Datenprodukte erstellen und betreiben können.

4. Federated Computational Governance: Governance wird nicht zentral diktiert, sondern als Policy-as-Code in die Plattform eingebettet. Globale Standards werden automatisiert durchgesetzt.

Die Stärke von Data Mesh liegt in der organisatorischen Skalierung: Es löst den Engpass zentraler Datenteams, die zum Flaschenhals für das gesamte Unternehmen werden.[1] Laut ThoughtWorks Technology Radar steht Data Mesh seit 2023 im Quadranten "Adopt" — allerdings mit der Einschränkung, dass die Umsetzung erhebliche organisatorische Reife voraussetzt.[4]

Data Mesh — Stärken

- Skaliert mit der Organisationsgröße

- Fachdomänen übernehmen Verantwortung

- Reduziert Abhängigkeit von zentralen Teams

- Fördert Datenqualität durch Ownership

- Ideal bei heterogener Systemlandschaft

Data Lakehouse — Stärken

- Einheitliche Plattform für alle Datentypen

- Geringere organisatorische Komplexität

- Starke Performance für BI und ML

- Bewährte Toolchains (SQL, Spark, dbt)

- Schnellere Time-to-Value bei kleinen Teams

"Data Mesh ist kein Technologie-Projekt, sondern ein organisatorisches Betriebsmodell. Wer es nur als Architektur-Pattern implementiert, wird scheitern."

— Zhamak Dehghani, Autorin von "Data Mesh: Delivering Data-Driven Value at Scale"[2]

Data Lakehouse: Die vereinheitlichte Plattform

Das Lakehouse-Konzept adressiert ein konkretes Problem: Die Trennung von Data Lake (günstige Speicherung, flexible Formate) und Data Warehouse (strukturierte Abfragen, hohe Performance) führt zu Datensilos, Inkonsistenzen und doppelter Infrastruktur.[3]

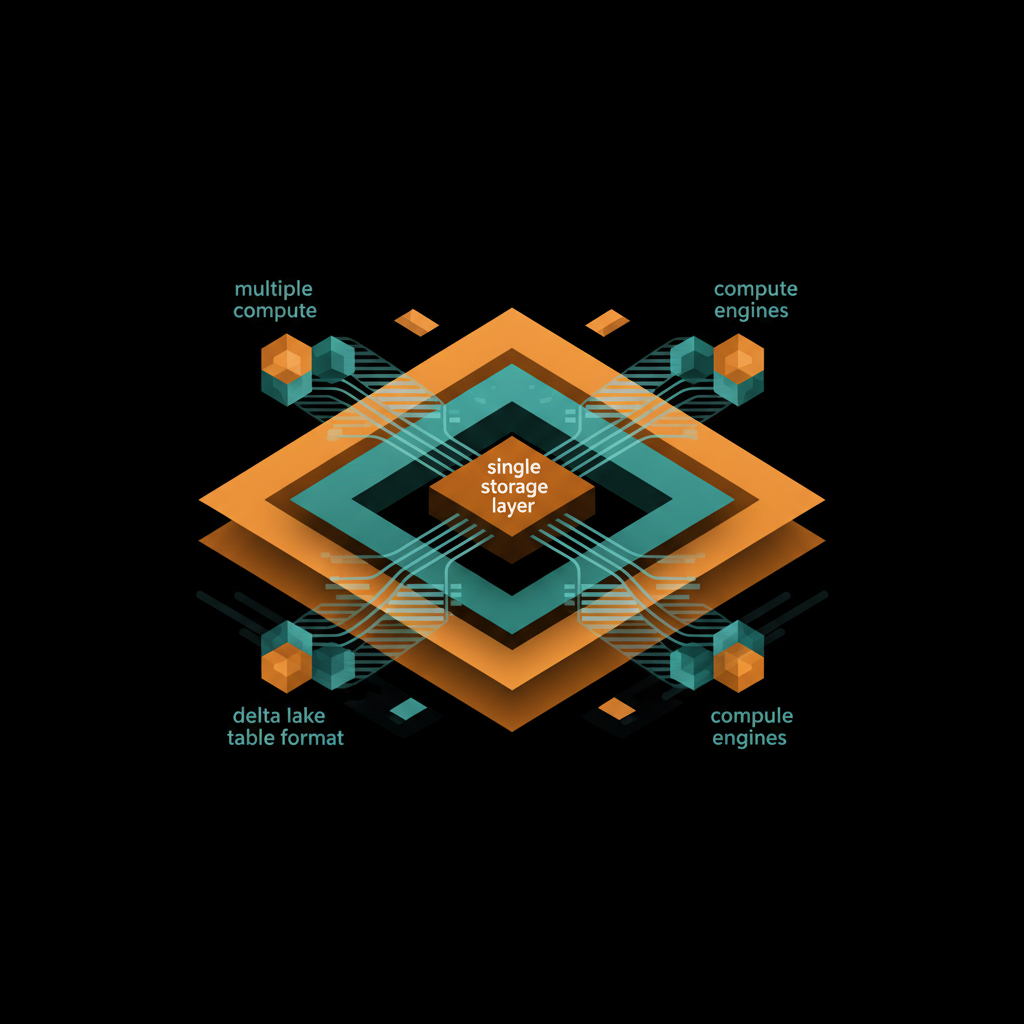

Die Lösung: Eine einzige Speicherschicht auf Open-Table-Formaten wie Delta Lake, Apache Iceberg oder Apache Hudi, die ACID-Transaktionen, Schema-Enforcement und performante SQL-Abfragen direkt auf dem Data Lake ermöglicht.[3]

Die Marktentwicklung bestätigt den Trend: Databricks meldete 2025 einen ARR von über 2,4 Milliarden USD.[5] Snowflake hat mit Snowpark und Iceberg-Support seine Plattform ebenfalls in Richtung Lakehouse erweitert. Gartner positioniert beide Anbieter als "Leaders" im Magic Quadrant for Cloud Database Management Systems 2025.[6]

Für den Mittelstand bietet das Lakehouse-Modell einen pragmatischen Einstieg: Eine Plattform, ein Datenformat, eine Governance-Schicht. Die organisatorische Komplexität ist deutlich geringer als bei einem vollständigen Data Mesh.

Handlungsempfehlungen für IT-Leiter

- Organisatorische Reife prüfen: Data Mesh erfordert autonome, datenaffine Domänen-Teams. Wenn Ihre Organisation noch zentral gesteuert wird, starten Sie mit einem Lakehouse

- Klein anfangen: Implementieren Sie zunächst ein Lakehouse als zentrale Plattform und führen Sie schrittweise Domain-Ownership-Prinzipien ein — das Beste aus beiden Welten

- Open Formats wählen: Setzen Sie auf Apache Iceberg oder Delta Lake statt proprietärer Formate. Das sichert Flexibilität bei Plattformwechseln

- Governance von Anfang an: Egal welches Modell — definieren Sie Data Quality Standards, Zugriffsrichtlinien und Daten-Katalog ab Tag eins

- Vendor Lock-in vermeiden: Evaluieren Sie Multi-Engine-Architekturen, die Compute und Storage entkoppeln

Quellen und Referenzen

- Gartner, "Market Guide for Data Lakehouses", Gartner Research, 2025

- Zhamak Dehghani, "Data Mesh: Delivering Data-Driven Value at Scale", O'Reilly Media, 2022

- Databricks, "What Is a Data Lakehouse?", databricks.com, 2024

- ThoughtWorks, "Technology Radar Vol. 30", thoughtworks.com, 2024

- Databricks, "Databricks Announces $2.4B ARR", Pressemitteilung, 2025

- Gartner, "Magic Quadrant for Cloud Database Management Systems", Gartner Research, 2025

- Snowflake, "Snowflake and Apache Iceberg: The Open Data Lakehouse", snowflake.com, 2024

- Martin Kleppmann, "Designing Data-Intensive Applications", O'Reilly Media, 2017